打6秒电话就知道你长什么样?这个麻省理工的AI神了!

听一段6秒的音频就可以还原你这个人的相貌,这可能吗?

最近来自MIT的麻省理工研究CSAIL(人工智能实验室)和谷歌的AI就发布了这样一项让人瞠目咂舌的研究。

只需要听6秒钟的音频,凭借AI技术就可以推断出说话者的样貌。

碟中谍都还不敢这么拍,人家CSAIL就已经做到了(牛逼!)

Speech2Face就能通过一段仅有6秒的语音片段,推测出说话者的年龄、姓名、国籍和种族等等信息,再根据这些信息开始重建他们的样貌。

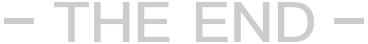

下面这组照片中,上面是他们本人的真实照片,下面是Speech2face通过声音还原出来的样子。

还原准确度非常高,和真人基本上相差无几!

他们这个研究的论文"Speech2Face: Learning the Face Behind a Voice"也入围了今年的学术*级会议CVPR 2019。

很多人觉得通过声音去还原样貌这一技术很不可思议。

但细想一下,其实我们在日常生活中,当我们隔着屏幕和一个未曾见面的人进行对话的时候,我们也会习惯性地根据这个人音色的高低粗细来判断性别和大致的年龄,还有根据口音去推断是哪一个地区的人。

这是因为,年龄、性别、嘴巴形状、面部骨骼结构,所有这些都会影响人发出的声音。

此外,语言、口音、速度通常会体现出一个的民族、地域、文化特征。

只不过我们做不到仅凭声音就能完全脑补出这个人样貌这么厉害。

而AI 就是凭借这些信息之间的关联性来进行推测还原的。

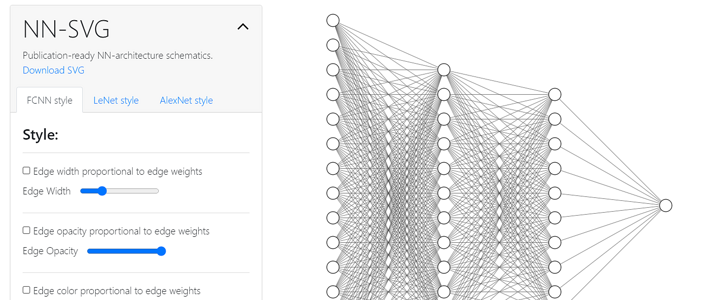

研究人员演示了模型学会声音和面部之间的关联性,例如年龄、性别和种族等,从而使得神经网络可以通过说话人的这些属性就能还原容貌。

在整个实验过程中都是由模型自我监督完成学习,不需要人类标记视频。

人们倍感神奇的同时,也引发了一些关于隐私方面的担忧。

在研发团队的特别声明中他们表示不追求精确百分百的还原单一个体的脸部图像。

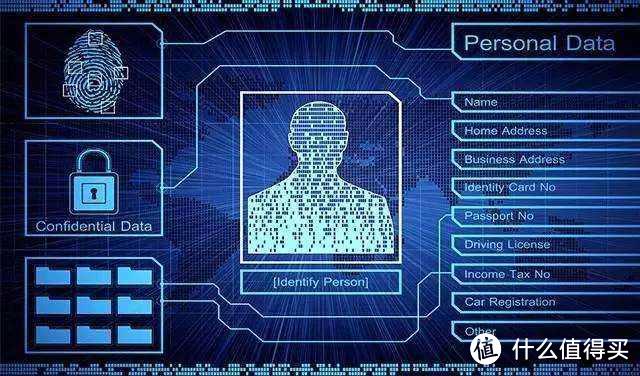

而且这套系统目前收录印度和黑人的数据还不够充足,所以还原效果还有待改善提高。

那么网络神经有没有翻车的时候呢?

有的。

在一些实验中,同一个人说不同的语言,系统有可能会识别成两个不一样的人。

例如研究人员让一名亚洲男子分别说英语和汉语,系统识别出了两幅不一样的面孔。

除了这个,还有一些更为尴尬的翻车现场,例如正处于变声器的男孩子可能会被误识别为女性,这就有点尴尬了。

也有把老年人识别成年轻人的,虽然你年纪大了,但是你声音听起来依然是个小年轻,这也算是一件好事吧。

试想一下这个技术被普及以后,和陌生人聊电话的时候,大家可能都会很想要一个柯南的蝴蝶结变声器来隐藏自己的真实身份了。