AI深度学习加速:QNAP 威联通 发布 Mustang-V100和Mustang-F100 加速卡

继去年的Mustang 200系列后,近日QNAP(威联通)又更新发布了两款运算加速卡,分别是:Mustang-V100 和Mustang-F100两款,分别基于英特尔VPU / FPGA加速解决方案,针对英特尔OpenVINO环境进行优化,可帮助英特尔服务器/PC或自家NAS加速,从而提升AI深度学习推理运算能力。

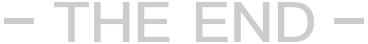

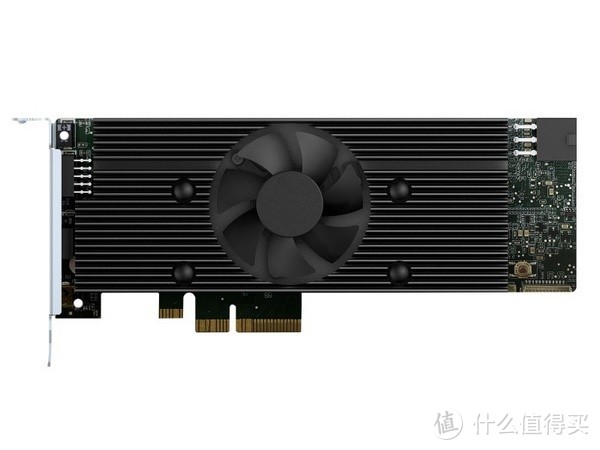

两款加速卡很像游戏显卡,都配备主动散热散热模组,个头稍小的Mustang-V100覆盖大面积黑化散热片,内嵌一把传统风扇,尺寸W63.58×D169.54×H19.58 mm,占用1.5槽空间,在QTS环境中最多可扩展8张加速卡;而个头稍大的Mustang-F100拥有双风扇散热器,外观相对精致拥有风罩,三围尺寸W63.58×D169.54×H19.58 mm,占用双槽空间,最多可扩展4张加速卡。

Mustang-V100配备8颗英特尔Movidius Myriad X MA2485 VPU芯片,支持PCI-Express 2.0(x 4)插槽,30W TDP,提供一个外接6pin供电。Mustang-F100采用英特尔Arria® 10 GX1150 FPGA芯片,支持PCI Express Gen3 x8插槽,60W TDP,同样配备单6Pin外接供电。

Mustang-V100和Mustang-F100加速卡可搭配OpenVINO开发工具包套件,让AI开发者可将训练好的模型部署于一台 QNAP NAS上进行推理,提供模型优化器和推论引擎,可将预先训练的深度学习模型 (如Caffe、TensorFlow) 转换成 IR 文件格式,优化处理影像分类及计算机视觉推理工作。此外,当使用QNAP NAS作为推理服务器时,支持最新QTS 4.4.0操作系统。