AI最前线 篇四十四:NVIDIA TensorRT-LLM提升Windows 11 PC的AI的性能

NVIDIA最近宣布将AI加速引入Windows 11 PC,这将受益于其最新的RTX GPU系列。具体来说,NVIDIA引入了名为TensorRT-LLM的技术,该技术将加速AI工作负载,对于运行RTX 40和RTX 30 GPU的Windows 11 PC用户来说,这是一个巨大的提升。

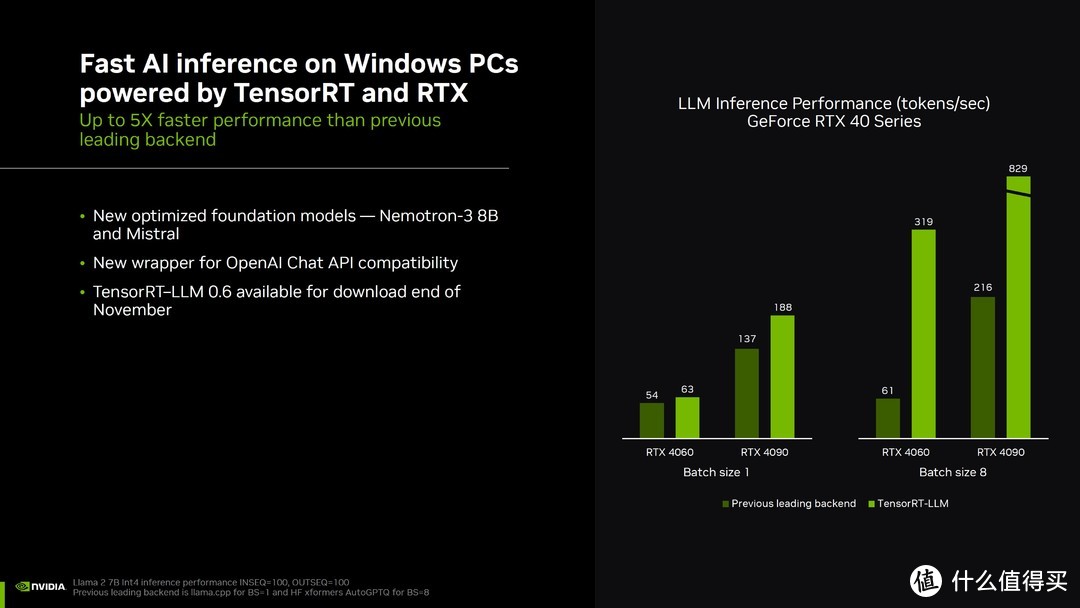

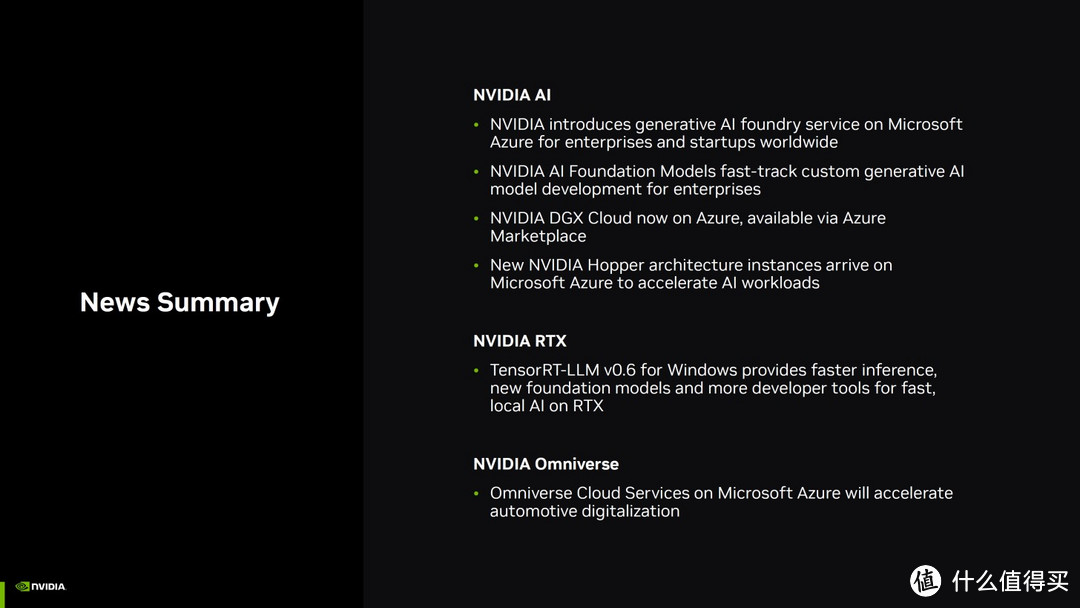

TensorRT-LLM的加速效果非常显著,据NVIDIA称,版本0.6.0将提供5倍的性能提升。这一功能将于本月晚些时候发布。此外,它还将支持其他LLM(Language Model)模型,如Mistral 7B和Nemotron 3 8B。

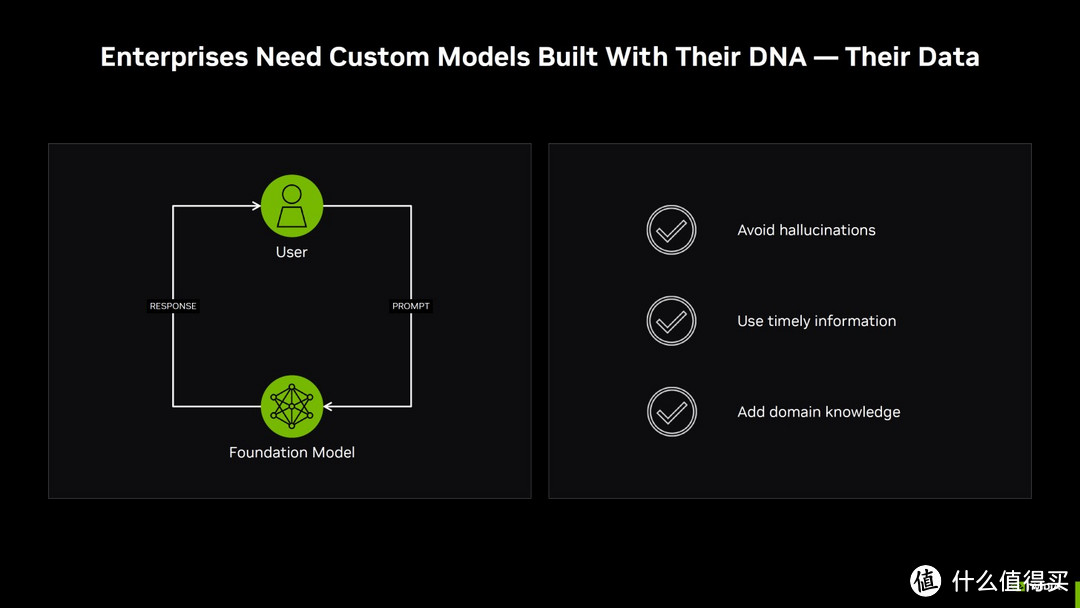

对于拥有支持TensorRT-LLM的NVIDIA RTX GPU的用户,这将意味着他们可以在本地存储所有数据和项目,而不必将它们保存在云端。这将节省时间并提供更精确的结果。其中一项技术,称为RAG(Retrieval Augamanted Generation),可以帮助加速AI结果生成,它使用本地化库,其中可以包含您希望LLM处理的数据集,并利用LLM的语言理解能力提供准确的结果。

此外,NVIDIA还与Microsoft合作,将DirectML增强引入Windows 11 PC,以提高流行的AI模型的性能,如Stable Diffusion和Llama 2。

这些举措对用户有何影响呢?首先,用户可以期待更快速的AI工作负载处理,这将加速各种任务,从文档处理到数据分析。而且,由于TensorRT-LLM的加速效果,用户可以在本地进行数据处理,而无需依赖云端。这将提高数据隐私和安全性,同时提高效率。

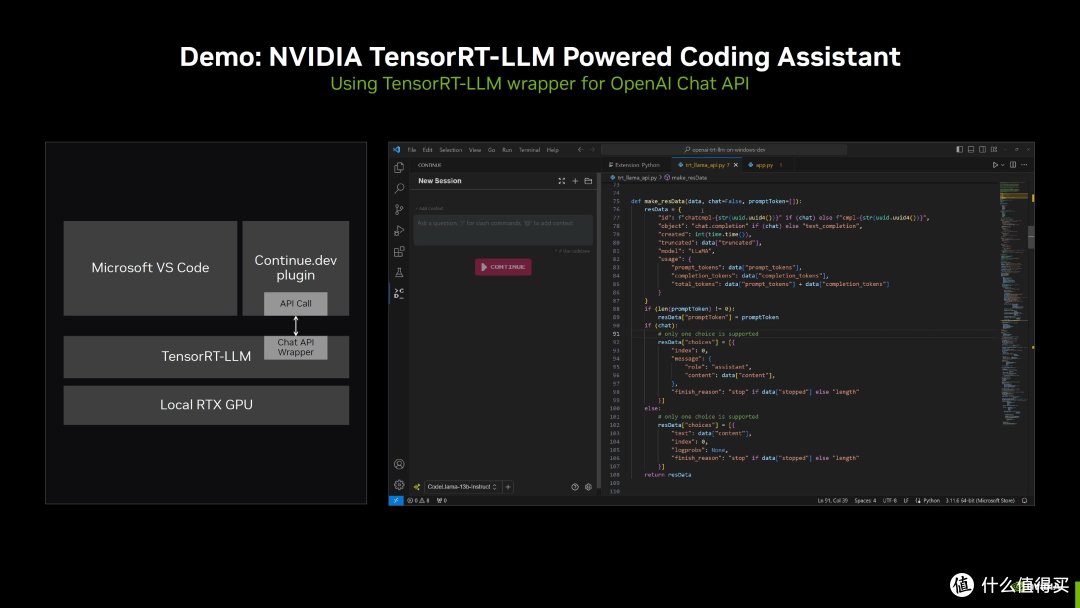

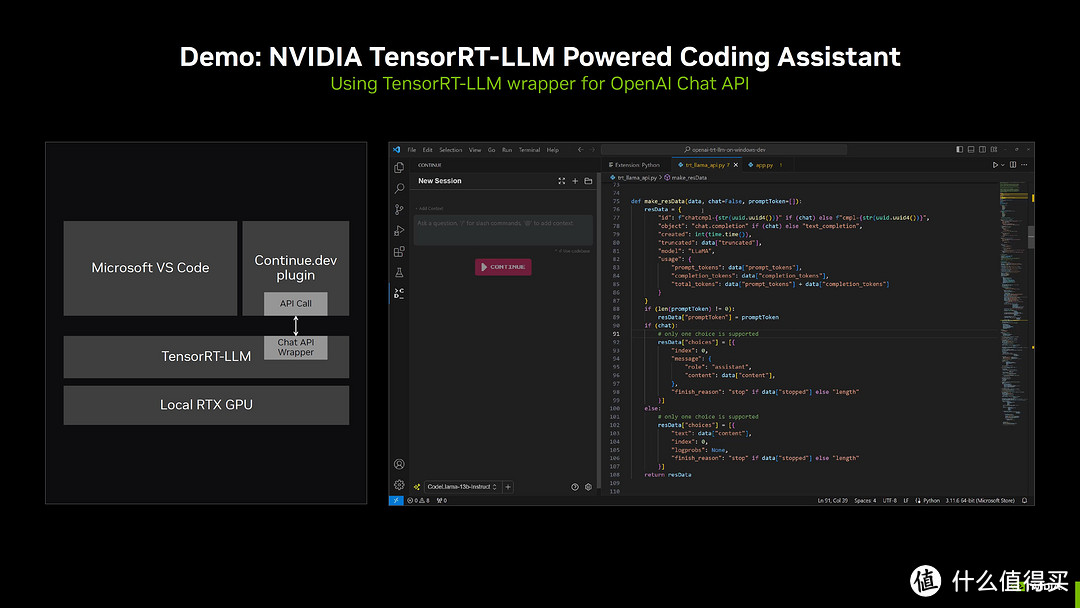

此外,对于使用OpenAI的ChatAPI的用户,这也带来了好消息。NVIDIA和Microsoft将提供一个API接口,通过一个新的包装器,将TensorRT-LLM加速引入OpenAI的ChatAPI。这意味着用户不必手动上传大量数据集,因为整个数据集将以本地可用的方式提供给ChatAPI。

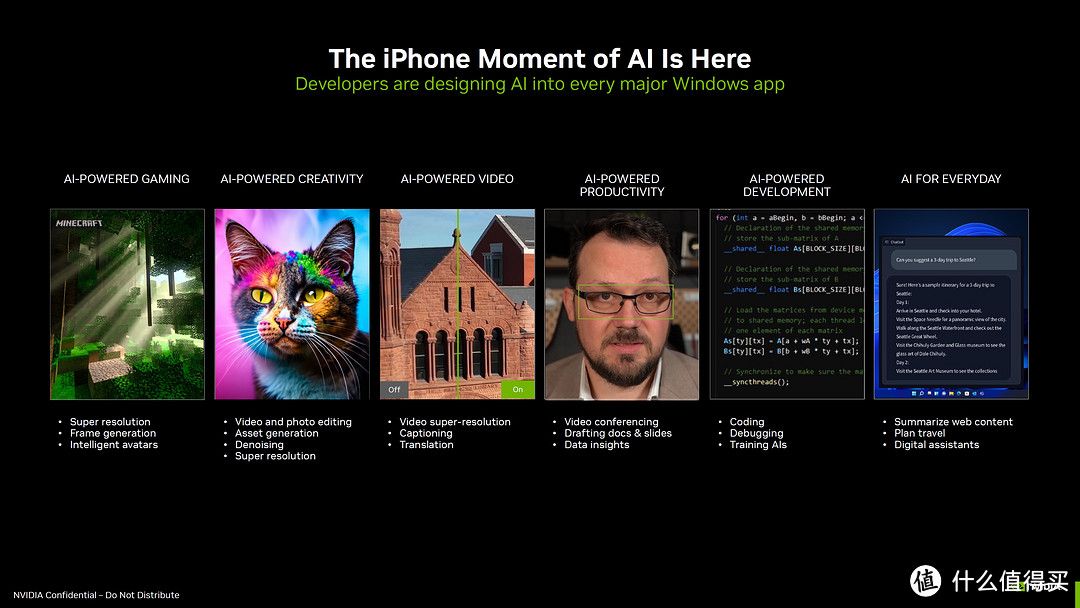

总之,NVIDIA的这些举措不仅有助于企业,也将使广大用户受益。AI加速不仅取决于硬件,还取决于软件的发展。TensorRT-LLM和DirectML的引入将有助于加速AI的应用,使其变得更加普及和高效。这对用户来说是一个重大进展,将提供更快速、更安全的AI体验。在未来,AI领域的竞争将日益激烈,但目前看来,NVIDIA凭借其硬件和软件专业知识,已经为未来的道路铺平了道路。

太平洋的水

校验提示文案

太平洋的水

校验提示文案

太平洋的水

校验提示文案

太平洋的水

校验提示文案