自动驾驶真的有用吗?在草原自驾游中检验智能驾驶技术!

都说自动驾驶,自动驾驶,那么在草原自驾游,信号不太好的情况下,智能驾驶技术有用吗?

现在的自动驾驶方案是“车内大智能、云端小智能”,这就决定了几乎自动驾驶所有的场景都依托于车内的计算能力,车内即可实现所有的逻辑闭环。

那么草原上是不是有信号(5G、4G),就无所谓的,都可以放心使用自动驾驶的功能。

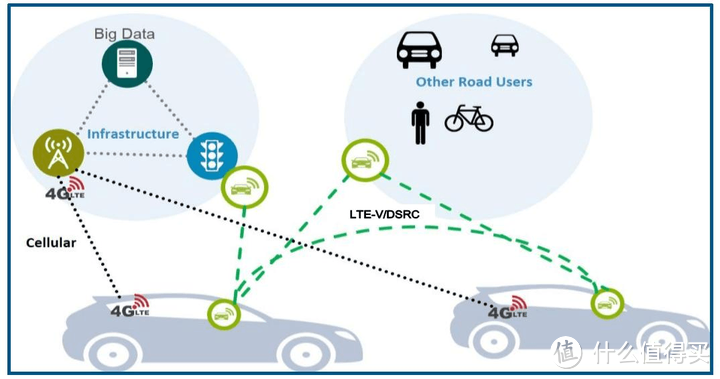

一、V2X并不好用

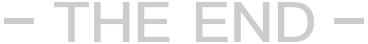

我们自动驾驶有两个发展方向ADAS+V2X

这里问题所提到的信号不好,只是影响V2X的发挥,但是就当下的技术和工程实践来看,V2X还处于示范运营阶段,还没有“走入寻常百姓家”,也就是现在的自动驾驶几乎不依赖网络信号。

那么我们为什么不使用V2X呢?

V2X的使用,第一大问题就是这个应用概念本身。为了说明这个问题,我们先从V2X这个名字说起,V是指汽车(vehicle),X是指世间万事万物,2是to链接,意味着汽车和万事万物的链接。这里首先遇到的问题就是X,即便汽车可以联网了,但是就当下来讲,围绕着汽车应用场景的X几乎还没有达成大规模联网的状态,没人和我通信,我还V2X个啥。限制了发展。

其次还有个问题,就是汽车联网能力本身,现在的我们手机所用的4G/5G网络,都是通过联通移动这样的公司,建设基站,然后覆盖生活场景的范围,达成联网的能力。手机应用场景完全没问题,因为,每个人都是固定在某个区域的。但是对于汽车来讲,日行几百公里,其活动范围非常大,比如我在西藏,新疆,群山,沙漠,草原这样广袤的地方行驶,移动公司就无法建设那么大范围的基站(经济效益原因),车辆一会可以联网,一会不可以联网,不稳定,就无法使用。

所以,现在的自动驾驶技术,都是主推ADAS功能,也就是车内智能,不依赖外物,有没有网络无所谓。

那么现在主流的自动驾驶方案是什么样的呢?

二、强车内智能的ADAS系统

ADAS是Advanced Driving Assistance System的简称。中文名叫做高级驾驶辅助系统。自动驾驶,也叫无人驾驶,依赖的就是这套系统。

我们想想,车辆没人开了,那么谁来实现了人的操作呢?就是ADAS,那么ADAS干了啥呢?就是干了人在车内操作的事情:

我们人开车,首先要眼观六路,耳听八方,获取道路周围的信息,这就是“感知”;然后我们看到前面需要拐弯了,看到绿灯了,这时候我们大脑发出指令:踩油门前进,这就是“决策”;最后,我们的脚步踩下油门,这就是“执行”。

同样的,adas系统的主要构成是三方面:感知+决策+执行。

就当下大家工程实践的状态来讲,感知最难、决策次之,执行最简单,下面分别简单讨论一下:

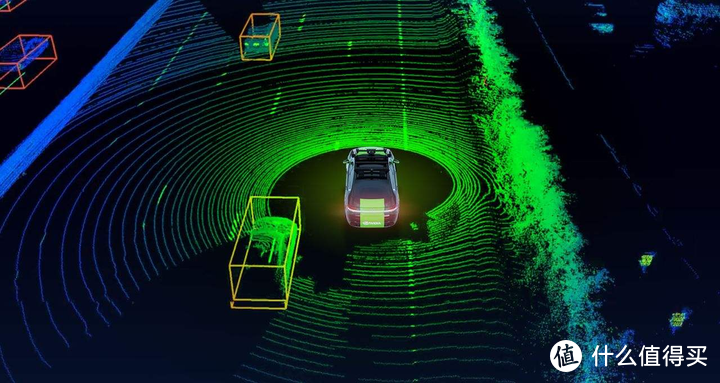

1.感知

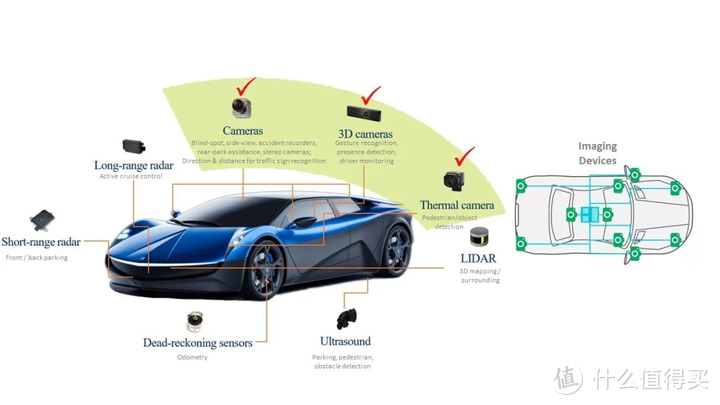

感知啊,我们想想我们人是怎么感知周围环境的?眼睛看、耳朵听、鼻子闻、手触摸,对于驾驶场景,我们主要是看。对于汽车看外面世界这件事,就需要各种传感器:

数码相机(摄像头):我们的眼睛,外界光子打在视网膜上,感光神经细胞可以形成感知;同样的,外界光子打在“硅传感器”上,传感器上布满的“感光像素点”,以电荷的形式形成感知。现在的数码相机的精度已经很高了,在很大程度上实现了人类眼睛的能力。但是数码相机最大的问题是没有“立体视觉”,虽然通过多布置几颗摄像头加以弥补,但是效果依旧不佳。另外,由于车辆行驶环境的不确定性,相机镜头污物污染问题无法彻底解决。强光线干扰问题也是相机的弊端,特斯拉美国车主行驶的时候,遇到夕阳,特定角度下,进行了误判,出了交通事故。

激光雷达:通过发射激光束来获取车辆周围的3D环境,它最大的好处就是能绘制出周围的高精度的3D立体模型。但是坏处就是价格高,速度慢(相比于雷达),对于那些驾驶过程的紧急场景无法应对。

普通雷达:如同平静的水面扔下一颗小石子荡起的波纹,雷达通过发射雷达波,接收反射波,感知定位物体。多普勒效应的原理,雷达还可以很方便的测得对方的行驶速度。

2.决策

决策最大的问题就是“及时”。决策主要考虑硬软两方面,硬件就是要有高算力的平台,软件就是算法模型。当然整个模型算法是发展迭代进化的:

CNN模型(2011-2016年):自动驾驶汽车最初大规模采用的就是CNN模型,也叫:卷积神经网络。CNN极大提升了自动驾驶车辆的环境感知能力

RNN模型(2016-2018):RNN也叫循环神经网络。相较于CNN,RNN更适合处理时间序列数据。它的循环结构可以建模时间上的动态变化,这对处理自动驾驶中的轨迹预测、行为分析等时序任务非常有用。

GAN模型(2016-2018):与RNN同步采用的GAN模型,也叫做“生成对抗网络”。它的生成能力缓解自动驾驶系统训练数据不足的问题。GAN可以学习复杂分布,生成高质量的合成数据,可用于缓解自动驾驶系统训练数据不足的问题。

BEV模型(2018-2020):BEV也叫做“鸟瞰模型”,核心思想是将车辆周围的三维环境数据(如来自激光雷达和摄像头的点云、图像等数据)投影到俯视平面上生成二维的鸟瞰图。这种从3D降维到2D的的方式,获得了一个巨大的好处:比原始传感器数据更加直观和信息丰富的环境表达。

Transformer模型(2021至今):Transformer模型最大的创新在于提出了“注意力机制”,这一机制极大地改进了模型学习远距离依赖关系的能力,突破了传统 RNN和CNN在处理长序列数据时的局限。

占用模型(2022-至今):占用网络基于学习将三维曲面表示为深度神经网络分类器的连续决策边界,可以在没有激光雷达提供点云数据的情况下对3D环境 进行重建,得到更加准确的三维场景信息。解决了鸟瞰图为2D图像,会缺失一些空间高度信息,无法真实反映物体在3D空间的实际占用体积的问题。

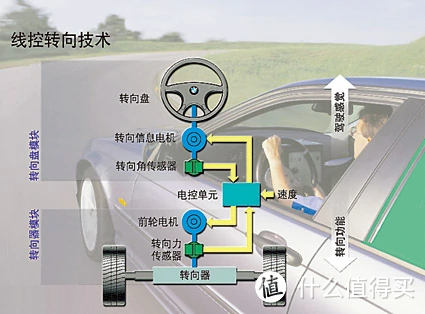

3.执行

提到执行,其实我们只需要关注“线控技术”即可。

该技术利用传感器将驾驶者输入信号传递到中央处理器、通过中央处理器的控制逻辑发送信号给相应的执行机构完成驾驶者的相关操作。这样可取代传统的机械结构,实现对汽车各种运动的电子线控。

综合以上,我们可以看到,对于自动驾驶汽车来讲,周身布置各种传感器,感知外界环境,通过进化的高效率的大模型算法,形成决策,最终通过线控技术,完成转向刹车等操作。完成自动驾驶。

这套系统是车内闭环的,无需外界的信号的输入。

所以在草原自驾游,信号不太好的情况下,智能驾驶技术依旧可以使用。

dirtytalk

校验提示文案

dirtytalk

校验提示文案