可乐漫画IT小课堂 篇三:红楼梦和机器学习还有渊源?

机器学习和《红楼梦》能扯上关系,Are you serious?我读书少,你别忽悠我。

其实我真不骗你,不信来瓶啤酒,听我给你慢慢掰扯。别看机器学习这几年很热门,其实它的历史相当的悠久。悠久到什么程度?如果从与机器学习相关的一些重要数学模型诞生开始算起,可以追溯到18世纪中叶。

1763年

托马斯·贝叶斯(Thomas Bayes)发表了一篇论文(其实是死后由其朋友帮助整理发表),题为《解决可能性问题的文章(An Essay towards solving a Problem in the Doctrine of Chances)》,奠定了贝叶斯理论的基础。贝叶斯是谁?学过概率论的人一定不陌生。没学过的话那不怪你,反正记住是个统计学界的鼻祖人物就行啦,地位和风清扬老前辈类似。他的独孤九剑,哦不对,是贝叶斯理论,在概率论、统计学和机器学习领域都是重要的基石。

这一年,在中国正是乾隆年间,《红楼梦》作者曹雪芹去世。看,这就是渊源……

1950年

这一年,同样是来自英国的另一位数学界的天才人物阿兰·图灵(Alan Turing)正式提出了“学习机(Learning Machine)”这个称谓,从理论上构想了一种能够学习任何东西的计算机。

图灵又是谁?计算机界无人不知,无人不晓。你不是计算机界的?没关系,记住他的地位跟洪七公差不多也就行啦。图老前辈虽然是个Gay,但曾经靠一套降龙十八掌,哦不对,是自己设计的破译机在二战时攻破了纳粹德国的军情加密系统英尼格马,为盟军的胜利立下汗马功劳。

可惜图老前辈40岁出头就吃了个含氰化物的苹果自杀身亡,为后世留下了许多遗憾。

1951年

在图灵提出学习机的概念之后仅仅一年,世界上第一个能够进行“学习”的机器模型SNARC(Stochastic Neural Analog Reinforcement Calculator,随机神经模拟强化计算器)就问世了。尽管这东西听上去很神经,也确实是个没有什么卵用的实验项目,但好歹正式拉开了机器学习的大门。

接下来,各国科学家和研究人员不忘初心,牢记使命,不断努力攻克难关,将人类的机器学习事业开展得如火如荼,带领全球码农从一个胜利走向下一个胜利,向着实现强人工智能的伟大目标奋勇前进……哎?抱歉,拿错稿子了,事情的真相不是这样的……

事实上,一开始也确实是如火如荼——1950年代后期直到1960年代末,机器学习的研究迎来了第一次春天。

1957年

IBM某位工程师发明了可以通过强化学习来玩井字棋(Tic-Tac-toe)的机器。没错,就是你们小时候经常拿块碎石头在水泥墙上玩的那种大叉圆圈棋。虽然和下围棋的阿花狗比起来只是个战五渣,但那好歹是50多年前,连个人电脑都还没发明的时代。

1967年

最简单的机器学习分类法——最近邻法(Nearest Neighbor,NN)诞生。用现在的眼光看,这种方法简陋(但其实对于很多问题效果仍旧不错),但是……拜托想想山顶洞人做的陶罐子吧,那可是代表了石器时代的先进技术。

1969年

正在大家以为大好形势会永远持续的时候,1969年发生了一件大事——

麻省理工学院(MIT)的哥们马文·明斯基(Marvin Minsky)和西莫·巴勃特(Seymour Papert)合作写了一本书,标题就叫《感知器(Perceptrons)》。这本书详细地研究和阐述了神经网络这种当时主流的机器学习模型,并指出了它的局限性。随后,整个人工智能研究的热点从当红的机器学习(主要是神经网络)转向了符号系统(Symbolic Systems)。自此机器学习的发展经历了一段寒冬。

喂喂,等一下。刚刚不还如火如荼,怎么一下子就寒冬了?

MIT在计算机界的地位,大概相当于少林寺。连少林寺的达摩院都出了本书说葵花宝典不是正途,那名门正派哪个还愿意练这个?科研项目的预算,尤其在西方国家那都是僧多粥少的局面,要靠抢的。一个没搞头的方向自然很难在预算竞争中胜出,预算没了,大家难道自掏腰包搞研究?当然指不定有那么几个教授对这个是真爱,还真能自掏腰包,可下面的研究生还得毕业找工作啊……找不到工作怎么落户、买房,娶老婆?

神经网络的局限性到底在哪里,为什么会浇灭全世界对机器学习的研究热情?这个我们以后专门开一篇来聊聊。如果非要用一句话总结一下,那就是对那个年代来说,这种模型太先进,用当时的硬件技术根本没法很好的支撑。这就好比你拿一个法拉利的车身装个1.4的发动机,空气动力设计再牛逼,百公里加速也跑不进5秒。

机器学习的研究虽然在70年代进入了冬天,但在随后的十几年里仍旧取得了一定的成果,比如递归神经网络和卷积神经网络这两种重要的模型形有了各自的雏形。然后,到了80年代中期,发生了另一件大事——

1986年

1986年,那是另一个春天,有一位老人在……哎?抱歉,又拿错稿子了。在这一年,三位研究人员成功的将反向传播算法(Back Propagation)用于神经网络的训练,从而开创了机器学习的全新篇章。什么是反向传播算法?这是一种可以让机器学习的模型自动朝着误差更小的方向进化的方法。大海航行靠剁手,反向传播算法就是机器学习的剁手。没有它就不会有现代的机器学习模型,也不会有深度学习、更不会有阿花狗之类的智能程序。不明觉厉?没关系,我们以后专门讲讲。

1989年

第一个面向个人电脑的商业化机器学习软件问世。这个叫做Evolver的软件使用的是遗传算法(Genetic Algorism),用来解决一些比如流程优化之类的问题。直到30年后的今天,这个软件居然还在卖,生命力之强简直堪比大Windows。

1995年

主要用作分类的著名机器学习模型支持向量机(Support Vector Machine,SVM)问世。

1997年

IBM的超级计算机深蓝在国际象棋比赛中力压国际特级大师卡斯帕罗夫,引起全世界吃瓜群众的广泛关注。人工智能的风暴第一次席卷普罗大众。自此以后的十年,机器学习进入加速发展期,各种模型、软件库、数据库和竞赛如雨后春笋般涌现出来。

2011年

IBM的自然语言理解系统在美国著名的电视智力竞赛(Jeopardy!)中战胜人类选手。

2014年

Facebook的人脸识别系统取得比人类更精确的识别准确率。

2016年

谷歌的围棋程序阿花狗(Alpha Go)在举世瞩目的人机大战中以4:1斩落韩国超一流棋手李世石九段,创造了历史。

至于后面的事情,你们都知道了。到了今天机器学习的程序在许多领域已经超过人类的能力,比如各种棋类、图像(包括人脸和字符)识别等等,但在其他大多数事情上,还是比较的。能够全面超过人类的强人工智能啥时候到来?也许是50年后,也许是500年后,没人说得清,或许它永远不到来更好(参见本系列第一篇)。

历史差不多回顾完了,最后咱们来一个思考题——为什么机器学习在历史上会遭遇低谷,而在2000年后又蓬勃发展起来?

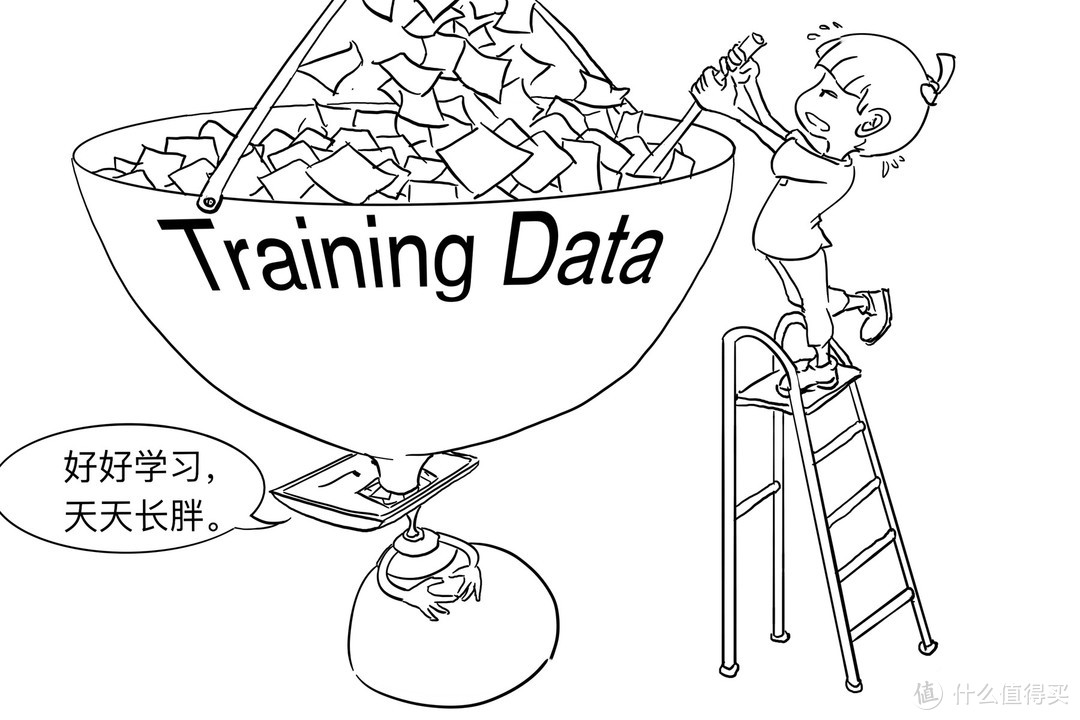

答案其实也挺简单的——因为好的机器学习模型都需要海量的(几百万、几千万、几亿条)训练数据和超大的计算量才能训练出比较好的结果。在2000年以前,用来做研究和测试的数据都是研究人员手工收集整理的,不要说上百万条,一个几千张图片的数据库都可以给研究人员的圈子用好几年。这点点数据对于神经网络这样的机器学习的模型来说连塞牙缝都不够。

就算有了足够的数据,计算机的运算速度跟不上也是没有卵用的。以当时的硬件水平,一个模型的训练花上一年半载,人家等着出论文拿学位的博士生估计只能跳楼或者转行送外卖了。所以不是马儿跑不快,实在是吃不饱草,也没有好鞍来配。

2000年以后,互联网的大发展让获取海量数据不再是问题,而硬件技术的提升也解决了算力的不足,大家这才发现,哎妈,原来这些个机器学习模型还有点用,弄好了还能卖钱,于是教授又能申请到经费了,研究生又不会毕不了业了,毕业了也不愁找不到工作了。人类的机器学习事业就这样恢复了生机。

这堂课差不多了,原谅我的标题党。你现在应该能回答下面的问题:

1. 机器学习的相关数学理论最早能追溯到什么时候?

2. 谁是现代计算机理论的奠基人?

3. 机器学习的寒冬期发生在什么时候?

4. 在2000年以前,限制机器学习发展的主要因素是什么?以及:

5. 机器学习和《红楼梦》到底有啥关系?

小编注:本文作者@ imeasy 是什么值得买生活家,他的个人自媒体信息为:

微信公众号:逸飞影话 ,微信搜索“YifeiPic”

扶持推广个人品牌是生活家新增福利,更多详细内容请了解生活家页面(https://zhiyou.smzdm.com/author/)。欢迎大家踊跃申请生活家,生活家中表现优异的用户还将有机会成为『首席生活家』,欢迎有着特别生活经验的值友们踊跃加入生活家大家庭!