谷歌Gemma本地化教程-Ollama and Ollama WebUI

前言

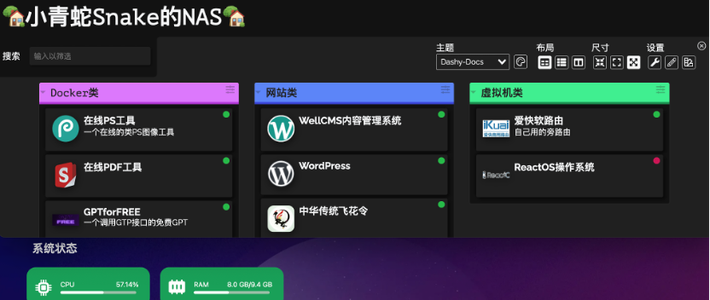

谷歌大语言模型Gemma是一个开源模型,利用大语言模型容器Ollama和Open Web UI,可以本地化使用,方便家人朋友无科学上网环境使用。

仓库

GitHub - open-webui/open-webui: User-friendly WebUI for LLMs (Formerly Ollama WebUI)

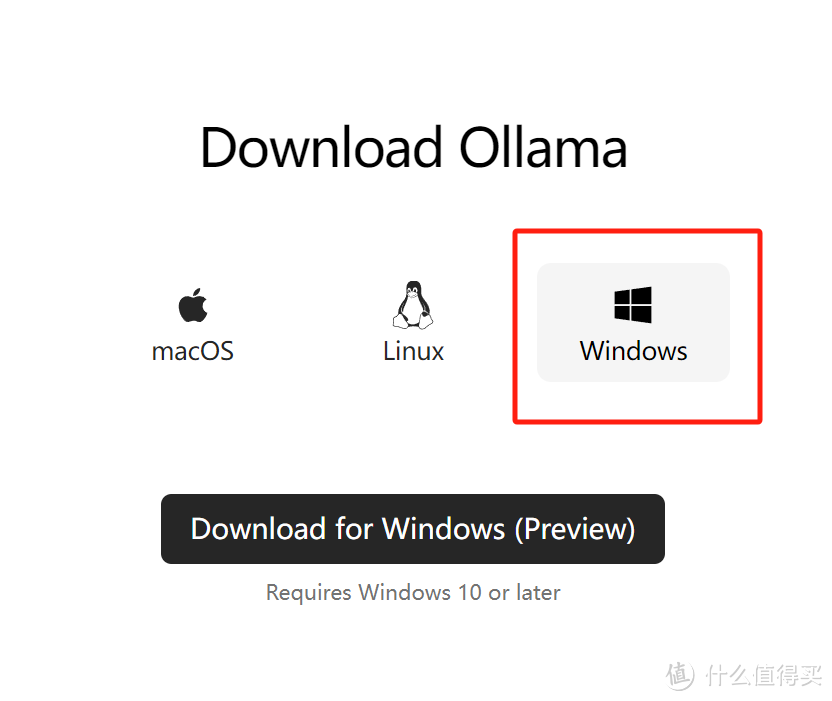

安装windows ollama

直接安装。

根据自己的显存大小大语言模型。

ollama run gemma:7b

ollama run gemma:7b-instruct-fp16

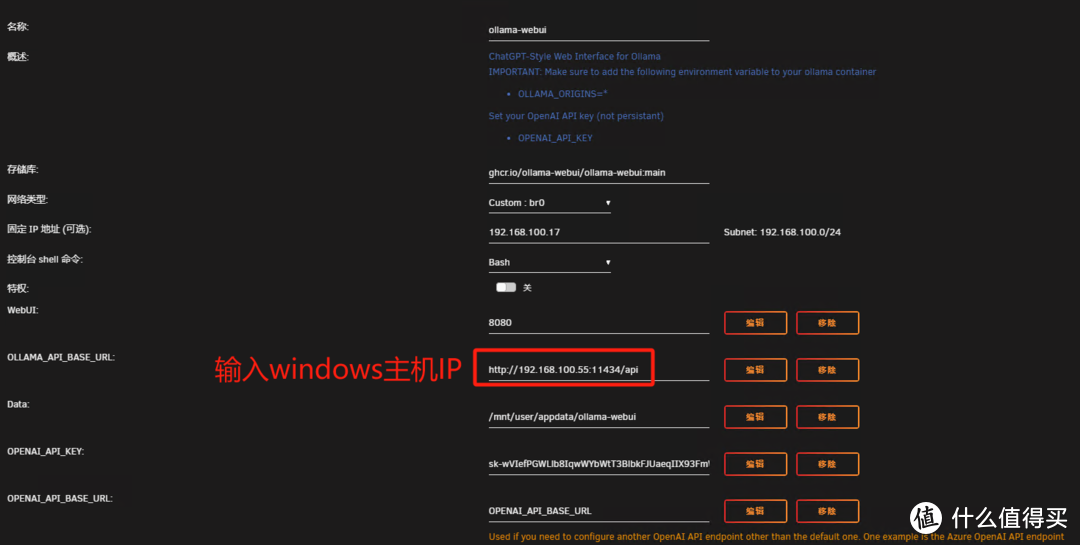

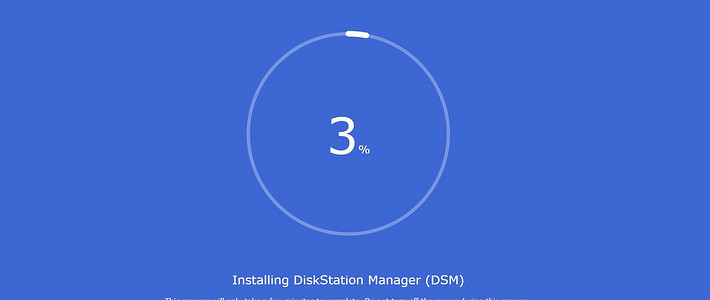

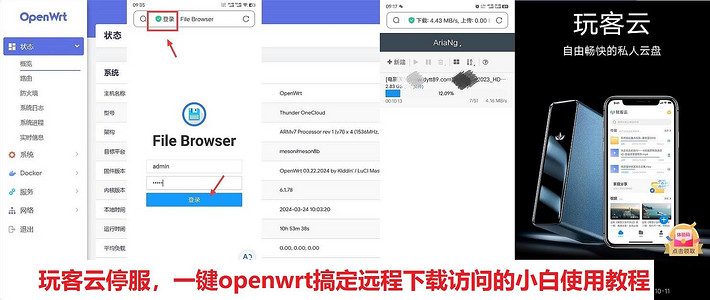

安装Docker 版本 Ollama Web UI

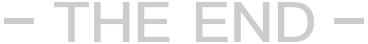

Unraid 应用搜索Ollama,安装。

修改IP

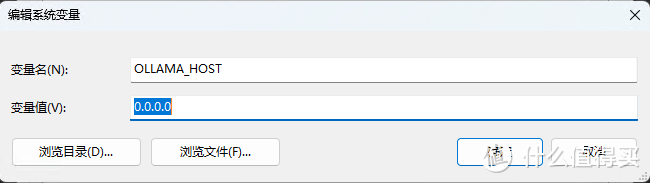

CMD输入,查看11434的端口是否只有127.0.0.1

netstat -ano | findstr 127.0.0.1

增加系统变量,重点,重点,重点。

此时Web UI可以本地化使用了。

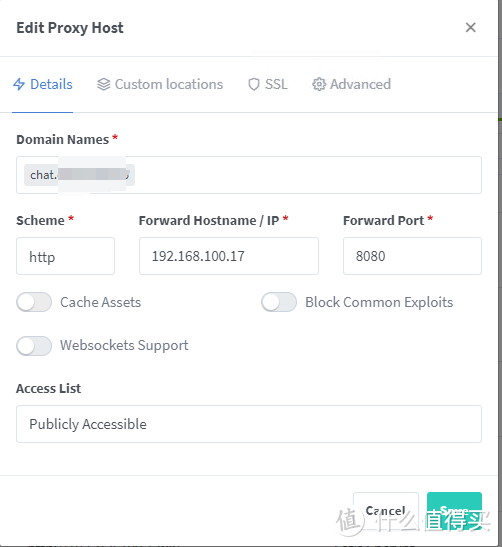

NPM反向代理

增加Web UI的IP和端口,强制转发

此时,外网都可以访问。

作者声明本文无利益相关,欢迎值友理性交流,和谐讨论~

Yamol

校验提示文案

snipergg

校验提示文案

万一免五开户

校验提示文案

值友1663613286

校验提示文案

值友1663613286

校验提示文案

万一免五开户

校验提示文案

snipergg

校验提示文案

Yamol

校验提示文案